george pagan/ unsplash

Oana Goga, Université Grenoble Alpes et Patrick Loiseau, Inria

Vous avez peut-être été stupéfaits par des pubs que vous recevez sur des plates-formes du web, peut-être vous êtes-vous inquiétés. Vous avez sûrement entendu parler de Cambridge Analytica et d’autres manipulations de la foule des internautes. Tout cela est mystérieux, opaque. Les recherches de deux informaticiens grenoblois, Oana Goga et Patrick Loiseau, les ont amenés à étudier le sujet. Ils racontent ce qu’ils ont appris. Cet article est publié en collaboration avec Le Blog Binaire.

La plate-forme de publicité de Facebook est fréquemment source de controverses en raison de potentielles violations de vie privée, de son opacité, et des possibilités de son utilisation par des acteurs malhonnêtes pour du ciblage discriminatoire ou même de la propagande destinée à influencer des élections.

Pour répondre à ces problèmes, de nombreux gouvernements et activistes prônent une augmentation de la transparence et de la responsabilité de Facebook au sujet des publicités qui circulent sur la plate-forme. Par exemple, le Règlement général sur la protection des données (RGPD) européen introduit un « droit à l’explication ». Toutefois, comment apporter de la transparence à un tel système reste une question largement ouverte sur le plan technique. En collaboration avec des chercheurs de l’institut Max Planck (Allemagne) pour les systèmes logiciels, de l’université de Northeastern (États-Unis), et de l’université fédérale du Minas Gerais (Brésil), nous explorons les différentes sources de risques dans les plates-formes de publicités des médias sociaux telles que celle de Facebook et des solutions pour les atténuer via des mécanismes de transparence.

Les abus sont facilités par certaines caractéristiques des plates‑formes

Pour bien comprendre pourquoi le problème est à la fois répandu et complexe à résoudre, commençons par regarder comment ces plates-formes fonctionnent. On peut distinguer principalement trois caractéristiques, inhérentes à leur fonctionnement, qui rendent la transparence à la fois plus importante et plus difficile :

- La plate-forme offre aux publicitaires un canal de communication privé avec chacun de ses utilisateurs : son « mur ». Il est donc impossible de savoir quelles publicités un utilisateur particulier reçoit, qui sont les publicitaires qui le ciblent et pourquoi ; ce qui rend les abus extrêmement difficiles à détecter.

- N’importe quel utilisateur possédant un compte Facebook peut devenir un publicitaire en quelques minutes sans vérification d’identité. Il n’y a donc aucune barrière pour des acteurs mal intentionnés souhaitant exploiter le système.

- La plate-forme met à disposition des publicitaires une quantité énorme de données sur les utilisateurs pour cibler très précisément certains segments de la population avec des messages susceptible de résonner en eux. Les publicitaires peuvent cibler les individus satisfaisant une combinaison précise d’attributs, avec plus de 1 000 attributs prédéfinis choisis dans une liste et plus de 240 000 attributs libres suggérés par la plate-forme lorsque le publicitaire tape des mots clés. On peut cibler par exemple les utilisateurs « intéressés par les enfants, mais pas par The Economist, ayant récemment déménagé et habitant au code postal 38 000 ». Les publicitaires peuvent également cibler des individus en particulier s’ils ont des informations appelées informations d’identification personnelle telles que l’email ou le numéro de téléphone.

Si on combine ces trois caractéristiques, on voit qu’un publicitaire peut cibler de façon très précise (ouvrant la voie à une manipulation potentielle) sans qu’il y ait de contrôle sur l’identité des publicitaires et sans qu’il n’y ait de possibilité pour un acteur extérieur (comme un régulateur) de vérifier l’absence d’abus.

lamauvaiseherbe.net, CC BY

Un premier audit externe de l’utilisation de la plate-forme

Puisque les publicités ciblées sont vues seulement par les utilisateurs ciblés en question, la seule façon d’auditer la plate-forme est de collecter directement les publicités montrées aux utilisateurs sur leur mur. Pour permettre un tel audit externe, nous avons développé une extension de navigateur, AdAnalyst que les utilisateurs peuvent installer et qui collecte (de façon anonyme) des données sur les différentes publicités reçues. En utilisant les données de plus de 600 utilisateurs, nous avons pu réunir des éléments de réponses à quelques questions importantes pour bien comprendre comment la plate-forme est utilisée et quelles sont les sources de risques potentiels :

- Qui sont les publicitaires ? Notre analyse révèle que 16 % des publicitaires sont peu populaires (ils ont moins de 1 000 likes sur leur page Facebook) et que seuls 36 % sont « vérifiés » (par un processus de vérification volontaire proposé par Facebook) et peuvent donc être tenus responsables de leurs publicités. Nous constatons aussi que plus de 10 % de publicitaires visent des catégories de sujets potentiellement sensibles (c’est-à-dire information/politique, éducation, finance, médecine, droit, religion) ; il est donc crucial et urgent de pouvoir les « monitorer » !

- Quelles stratégies de ciblage utilisent les publicitaires ? Une fraction importante des publicitaires (20 %) utilisent des stratégies de ciblage qui, soit potentiellement envahissent votre vie privée (c’est-à-dire basées sur les informations d’identification personnelle ou sur des attributs de tierces parties collectés en dehors de la plate-forme par des compagnies appelées data brokers qui les vendent ensuite à Facebook), soit sont opaques (c’est-à-dire utilisant la fonction « lookalike audience » de Facebook qui laisse le réseau social sélectionner les utilisateurs ciblés sur la base d’un algorithme de « similarité » privé). Cela représente une transition par rapport au mode de ciblage plus classique (et mieux compris) basé sur la localisation, sur les attributs démographiques ou de comportement, ou sur le re-ciblage (pratique qui consiste à montrer des publicités pour des produits que vous avez précédemment cherchés par vous-même).

- Quels attributs les publicitaires utilisent-ils ? Même lorsque ce mode plus classique de ciblage sur les attributs est utilisé, il peut être source d’inquiétude. En effet, les attributs « voyage » ou « nourriture et boisson » restent les plus utilisés, mais une fraction surprenante de publicités (39 %) utilisent des attributs libres qui sont beaucoup plus spécifiques et peuvent être beaucoup plus sensibles : on trouve par exemple des attributs tels que « connaissance du diabète de type 1 », ou un intérêt pour diverses organisations ou actions telles que « Adult Children of Alcoholics » (adulte dont les parents sont alcooliques) ou « Defeat Depression » (vaincre la dépression).

- Les publicitaires adaptent-ils leurs publicités aux sujets ciblés ? Nous avons découvert que 65 % des publicitaires adaptent effectivement le contenu de leurs publicités en fonction des attributs ciblés. Par exemple, Vice News (un site américain d’information généraliste) envoyait aux utilisateurs intéressés par PC Magazine (un magazine spécialisé dans la technologie) une publicité pour un article « A self-driving, flying taxi could soon be a reality » (un taxi volant autonome sera bientôt une réalité) et aux utilisateurs intéressés par le Parti démocrate une publicité pour un article « Mr. Trump and Mr. Cohen have a lot of explaining to do » (M. Trump et M. Cohen ont beaucoup à expliquer). Si ces pratiques ne sont pas malveillantes en elles-mêmes et existent d’ailleurs aussi dans le monde déconnecté, elles requièrent une attention particulière dans le cas de la publicité en ligne car elles ouvrent la porte à une manipulation fine par l’intermédiaire du micro-ciblage. Dans un autre contexte, nous avons mis en évidence par exemple que cette pratique a été utilisée par la Russian Intelligence Agency pour envoyer des publicités clivantes de façon ciblée aux utilisateurs vulnérables pendant l’élection présidentielle américaine de 2016.

Malgré des réponses intéressantes, cette étude du cas de Facebook ne révèle qu’une petite partie émergée de l’iceberg que représente l’écosystème de la publicité dans les médias sociaux et met surtout en lumière le besoin de travaux supplémentaires pour comprendre l’écosystème et son impact sur les utilisateurs.

Oscar Berg/Flickr, CC BY-NC-SA

Quid des mécanismes de transparence ?

Pour répondre aux inquiétudes des utilisateurs, les plates-formes ont récemment commencé à offrir des mécanismes de transparence. Facebook (en premier) a introduit un bouton « Pourquoi je vois cette pub ? » qui fournit aux utilisateurs une explication pour chaque publicité du type : « Une des raisons pour lesquelles vous voyez cette publicité est que Würth France souhaite atteindre les personnes intéressées par Industrie automobile, en fonction d’activités comme les Pages aimées ou les clics sur les pubs. D’autres raisons peuvent expliquer que vous voyiez cette publicité, notamment que Würth France souhaite atteindre les hommes de 24 à 58 ans qui habitent en France. Cette information est basée sur votre profil Facebook et les lieux où vous vous connectez à Internet. »

Même si ces explications ne fournissent d’information que sur une petite partie du processus de délivrance des publicités (le choix de l’audience par le publicitaire), elle constitue a priori un bon début ; mais il est toutefois indispensable de les auditer afin de s’assurer de la qualité de l’information fournie aux utilisateurs ! Pour ce faire, nous avons créé des campagnes de publicité contrôlées ciblant les utilisateurs volontaires d’AdAnalyst et collecté les explications reçues que nous avons alors comparées aux paramètres effectifs des campagnes. Nos résultats montrent que les explications fournies par Facebook sont loin d’être parfaites.

Nos expériences montrent d’abord que les explications de Facebook sont incomplètes d’une façon potentiellement inquiétante. Dans le détail, on observe que l’explication montre au plus un attribut même si plusieurs ont été utilisés pour le ciblage. Plus inquiétant, l’attribut montré est choisi de façon surprenante. Il est d’abord choisi en fonction du type d’attribut, en donnant la priorité aux attributs démographiques par rapport aux attributs d’intérêt et de comportement. Ensuite, l’attribut montré est celui qui a la plus grande prévalence (c’est-à-dire, qui est partagé par le plus grand nombre d’utilisateurs de Facebook). Ne révéler que l’attribut le plus commun ne semble pas être en mesure de fournir des explications utiles pour les utilisateurs. Imaginez par exemple un publicitaire qui ciblerait des utilisateurs intéressés par le fascisme et ayant un téléphone portable, l’explication ne mentionnerait que l’attribut téléphone portable. En plus de donner une information très partielle, une telle explication apparaît facilement manipulable par un publicitaire mal intentionné qui pourra par exemple masquer un attribut rare et discriminatoire ou sensible en y ajoutant un attribut très commun.

Nos expériences ont aussi montré que les explications de Facebook suggèrent parfois des attributs qui n’ont en fait pas été utilisés par le publicitaire ; ce qui au minimum induit en erreur et risque de briser la confiance de l’utilisateur dans les mécanismes de transparence offerts.

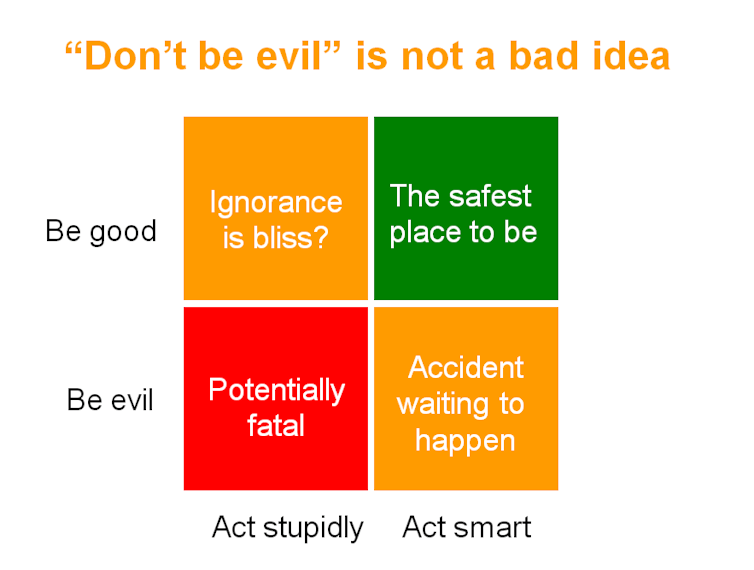

Dans l’ensemble, cette étude nous met en garde sur le fait qu’il ne suffit pas de donner n’importe quelle explication pour apporter de la transparence ; et même si notre étude a été menée sur la plate-forme de Facebook, cette conclusion s’applique à l’ensemble des plates-formes. Des explications mal conçues peuvent être dangereuses car elles offrent seulement une partie de l’information, peuvent être facilement manipulées par des acteurs mal intentionnés et donnent un faux sentiment de confiance. Il est donc crucial d’avancer sur des bases scientifiques rigoureuses pour définir des standards pour les explications si nous voulons que de tels mécanismes de transparence soient un succès.

Comment avancer vers plus de transparence ?

Il n’existe malheureusement pas de réponse définitive à cette question pour l’instant. Toutefois nous pensons qu’il est fondamental que la transparence soit apportée par des tierces parties et ne vienne pas directement des plates-formes sans possibilité d’audit. C’est aussi pour aller dans cette direction que nous avons conçu l’outil AdAnalyst qui fournit aux utilisateurs des statistiques agrégées sur les publicités reçues, les publicitaires les ayant ciblés et les méthodes de ciblage utilisées mais aussi les autres attributs utilisés par un publicitaire pour d’autres utilisateurs. Nous espérons que cela donnera aux utilisateurs une vision plus complète de la façon dont ils sont affectés par la publicité sur Facebook pour qu’ils puissent en prendre conscience et se protéger contre les pratiques malhonnêtes – en attendant que la transparence soit mieux réglementée.

AdAnalyst peut être téléchargé ici.![]()

Oana Goga, Research scientist, Centre national de la recherche scientifique (CNRS), Université Grenoble Alpes et Patrick Loiseau, Research Scientist in the POLARIS team, Inria

Cet article est republié à partir de The Conversation sous licence Creative Commons. Lire l’article original.

![]()